图1 工作机器人整体定位流程图

Fig.1 Flow chart of total positioning of work robot

崔宝侠, 栾婷婷, 张 驰, 段 勇

(沈阳工业大学 信息科学与工程学院, 沈阳 110870)

摘 要:针对移动机器人自定位精度低的问题,提出了先由静止的工作机器人进行自定位,再对运动目标进行检测和定位的方法.基于HSV模型颜色特征,工作机器人分割出人工路标并进行自定位,利用帧间差分法将采集到的视频图像序列中相邻两帧作差分运算,提取出运动目标,并通过双目立体视觉视差原理计算出运动目标的绝对坐标,帮助运动目标完成定位.结果表明,该方法定位精度高于传统的移动机器人自定位的定位精度,且算法的实时性好,具有现实的研究意义.

关 键 词:双目视觉; 移动机器人; 帧间差分法; 运动目标; 人工路标; HSV模型; 阈值分割; 定位

双目立体视觉采用的是类似于人的左右眼识别、理解外界的方式,利用左右两部并行排列的CCD镜头分别获取外界图像,对两幅图进行处理以获得外界的3D信息[1].双目立体视觉是计算机视觉研究中的一个重要分支,能直接模仿人类双眼处理客观场景[2],可以代替人类在危险系数较高的场合(如重度污染区、核辐射区以及有炸弹包裹的大楼等)工作[3].

定位是其执行其他任务的前提和基础,也是评价机器人性能的关键指标之一[4].目前的双目视觉移动机器人在定位过程中,一般都是采用移动机器人用双目摄像机直接采集路标完成自定位的方法,这种方法简单高效,但是具有一定的缺陷,即双目视觉传感器可能由于过快或不平稳的运动使得采集路标的图像模糊不准确,导致自定位误差较大,而且移动机器人可能运动到阴暗或难以采集路标的位置,会出现无法采集到路标的情况.

针对以上缺陷,文中提出了一种新的定位方法,即由另一个机器人代替移动机器人完成定位,负责定位工作的机器人可以在能够检测到路标和移动机器人的位置保持静止状态,利用传感器完成自定位,再为移动机器人进行定位并实时为其传达位置信息.

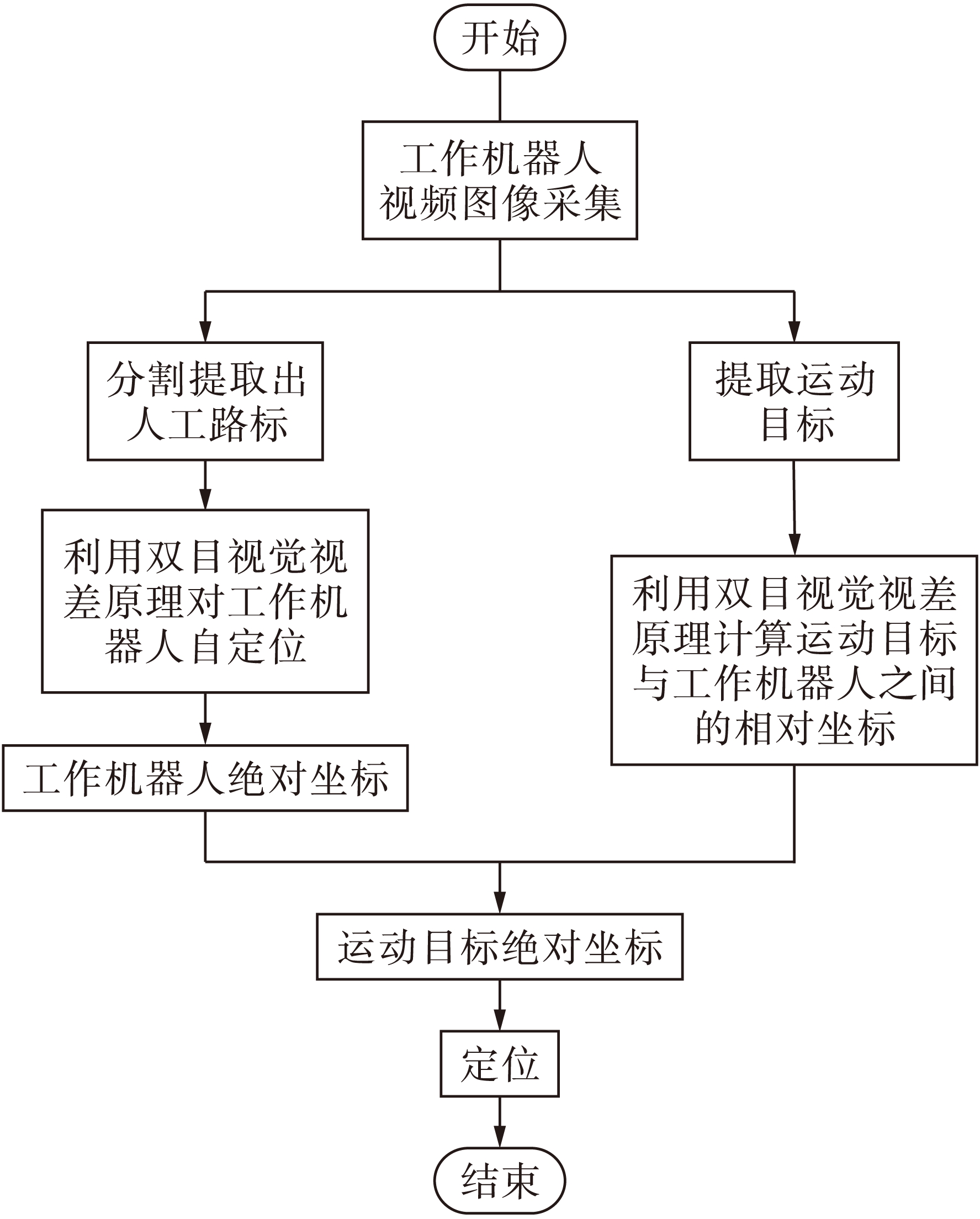

工作机器人整体的定位流程如图1所示,工作机器人首先采集带有移动机器人与人工路标的视频,然后对视频进行两方面的处理:一方面是分割提取人工路标并找到其质心,根据视差原理求出工作机器人与人工路标质心的相对位置,在实验环境中已知人工路标的质心坐标,这样就能求出工作机器人的绝对坐标,从而完成其自定位;另一方面工作机器人通过对视频图像的处理提取出运动目标,也根据视差原理得到工作机器人与移动机器人的相对位置,由于工作机器人的绝对坐标已经得到,因此可以计算出移动机器人的绝对坐标,即完成了工作机器人自定位及对运动目标检测与定位的任务.

图1 工作机器人整体定位流程图

Fig.1 Flow chart of total positioning of work robot

本文分别介绍人工路标与运动目标的检测方法,并通过实验比较了工作机器人帮助移动机器人自定位法与传统移动机器人自定位法的优劣.

1.1 人工路标检测

1.1.1 HSV颜色模型

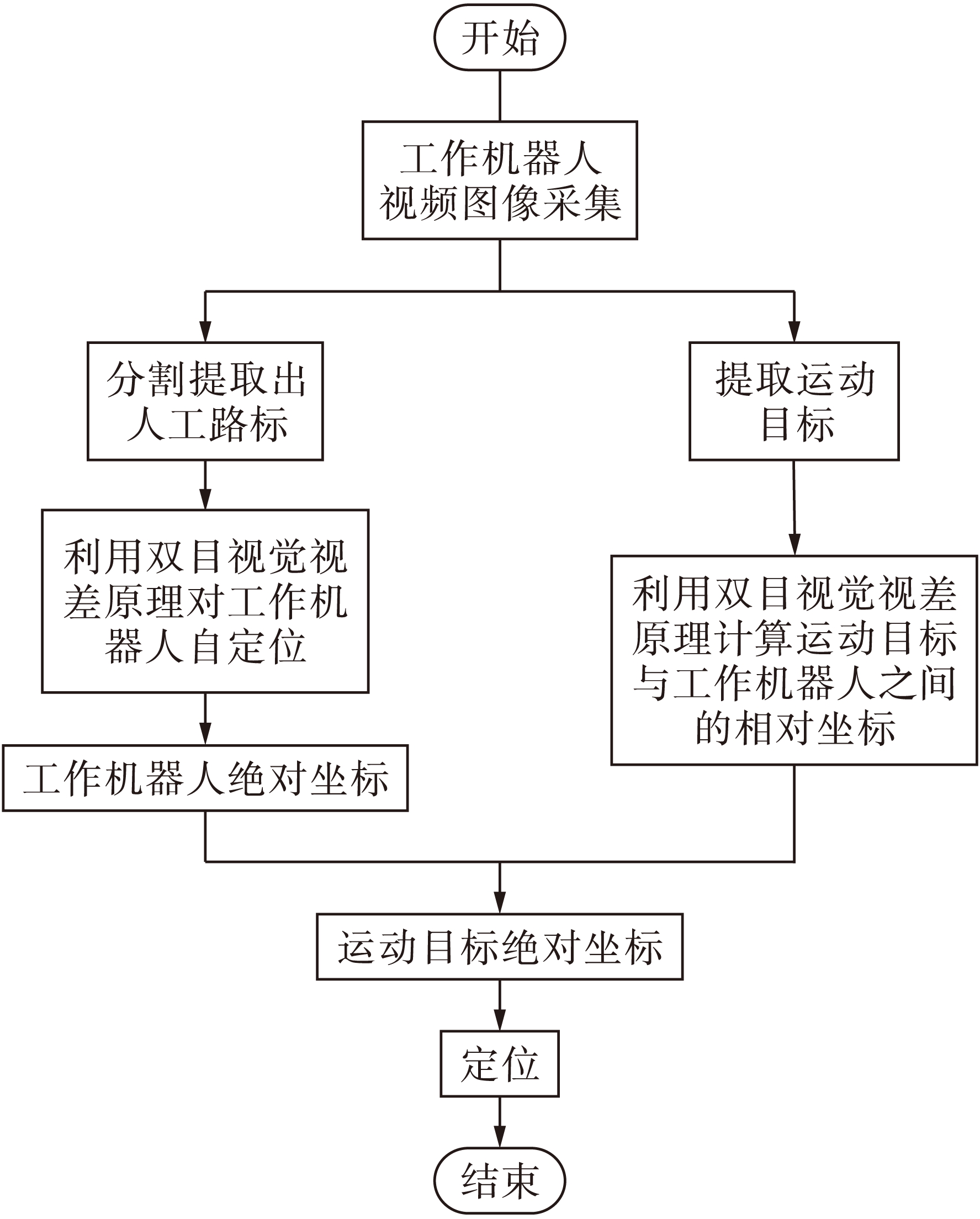

RGB色彩空间是一种常见的颜色表示法,通常摄像机拍摄到的图像都是基于RGB模型,但RGB色彩空间与人眼的感知差异大,其空间的相似不代表实际颜色的相似[5].为了符合人的视觉特征,同时也由于从RGB到HSV的转换是一个简单且快速的非线性变换[6],本文采用HSV色彩空间颜色模型,如图2a所示.在HSV色彩空间颜色模型中,H和S是色度信息,且独立于亮度信息V,这是HSV模型的一个重要优点[7].色调(H)代表颜色信息,取值范围为0~360°,对其设定阈值可以区分不同颜色的路标;饱和度(S)表示颜色的深浅,取值范围为0~1,S越大,颜色越深;亮度(V)表示颜色的明暗程度,取值范围为0~1,V越大,物体亮度越高.将HSV圆柱模型展开成如图2b所示平面模型,色彩从左至右代表模型中H分量沿逆时针方向从0°变化到360°,从下至上代表饱和度S由中心向圆周渐变,最右侧灰度图代表亮度V.

图2 HSV模型示意图

Fig.2 Schematic HSV model

1.1.2 基于颜色特征提取人工路标

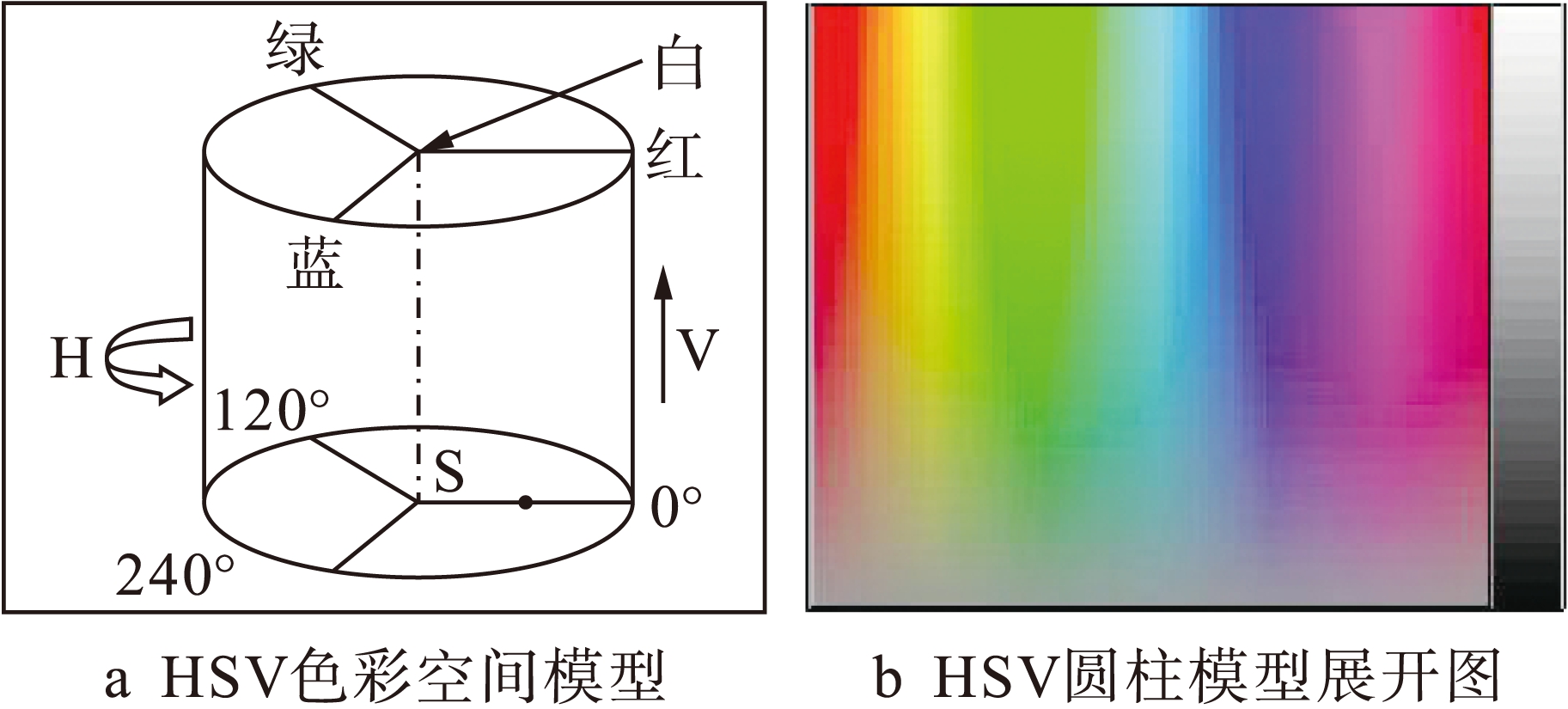

本文设计的人工路标是由红、蓝、黄三种颜色组成的矩形纸板.图3a所示为左目摄像机拍摄到的机器人所处环境示意图;利用HSV颜色模型对H、S、V三分量进行阈值的设置即可将人工路标提取出来(如图3b所示),但效果不理想,人工路标内部有细小的空洞;而利用相关运算对其进行图像处理后,人工路标内部细小的空洞被填平,提取效果较好,如图3c所示.

1.2 运动目标检测

1.2.1 帧间差分法

帧间差分法[8]是通过对视频图像序列中相邻两帧作差分运算来获得运动目标轮廓信息,即

![]()

(1)

对差分结果阈值判断可以采用式(2),即

图3 人工路标分割提取结果示意图

Fig.3 Schematic segmentation and extraction results of artificial landmark![]()

(2)

大于阈值的判断为前景,小于阈值的则判断为背景,从而突出运动区域,确定运动目标.帧间差分法的优点是算法实现简单,对光线等场景变化不太敏感,稳定性好.

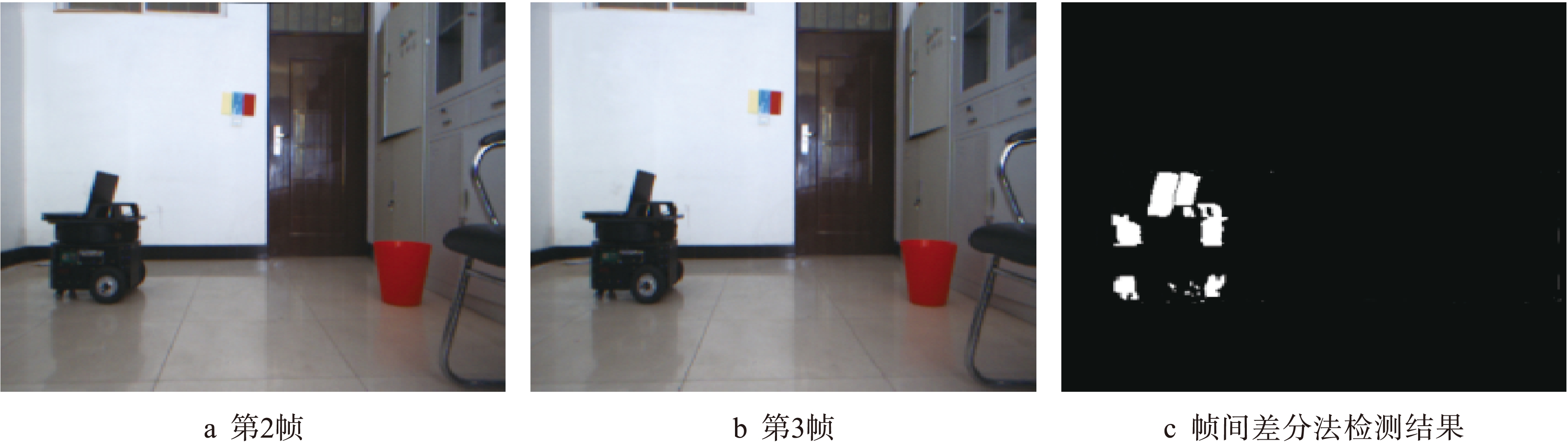

1.2.2 检测结果

移动机器人水平向右运动,图4a、b分别为运动过程中双目摄像机左目采集到的第2帧和第3帧视频图像,图4c为利用帧间差分法检测到的运动目标示意图.检测结果显示,帧间差分法能够将运动目标的轮廓提取出来.

图4 采用帧间差分法检测运动目标

Fig.4 Detection of moving object with frame differential method

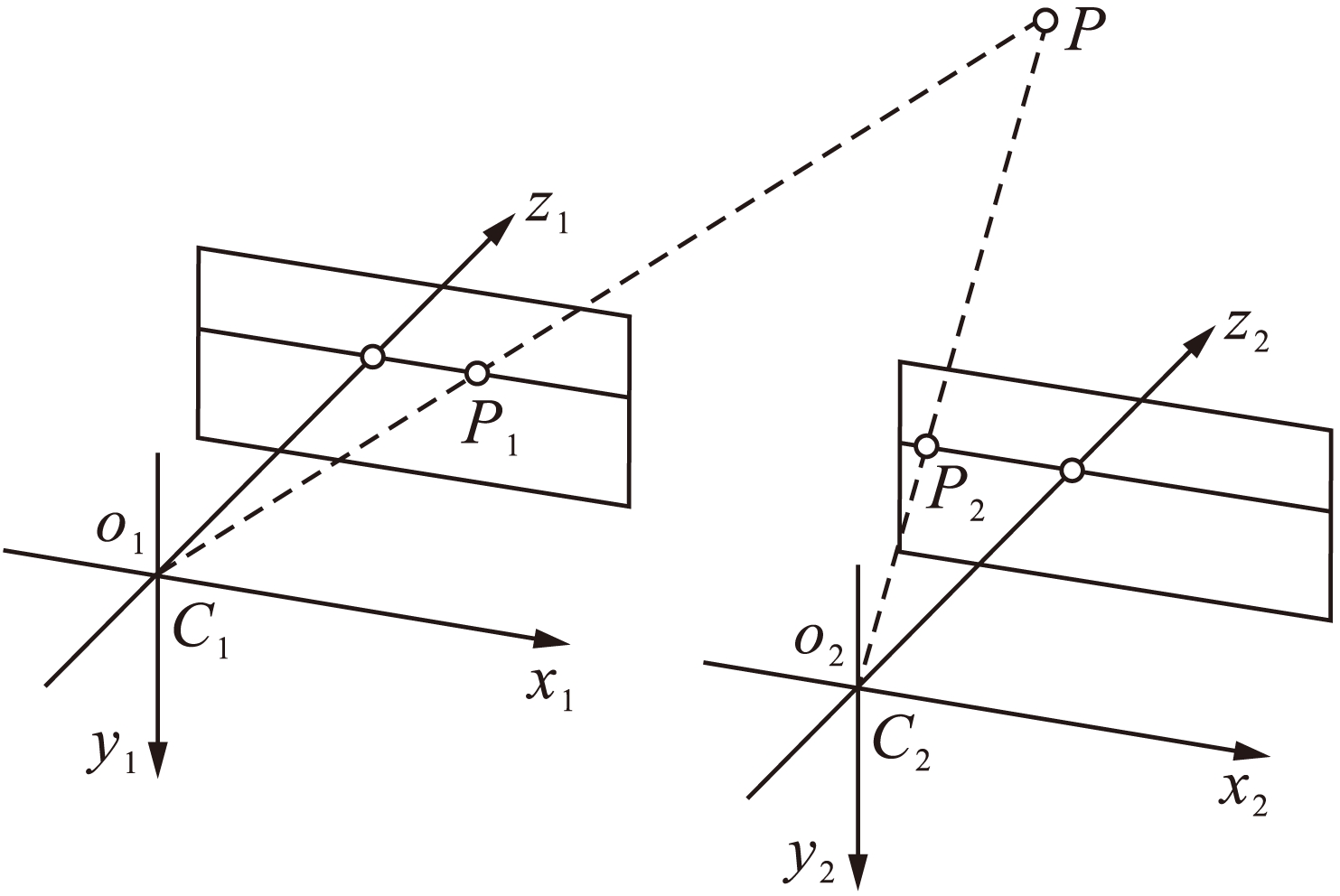

2.1 双目立体视觉原理

利用两台摄像机从两个视点观察同一景物,以获取在不同视角下的感知图像,通过计算空间点在两幅图像中的视差来获取目标物体的三维坐标,该原理即是视差测距原理[9].空间点在双目摄像机中的成像示意图如图5所示.

2.2 工作机器人自定位

首先,基于HSV颜色特征对采集到的左右两幅图像中的人工路标进行阈值分割,其次,计算左右两幅图像中人工路标的中心点坐标,将其作为一对匹配点,利用双目视觉视差原理计算人工路标在摄像机坐标系下的三维坐标,由于人工路标是人为设置的,其在坐标系下的绝对坐标已知,由此可以得到摄像机坐标系与环境坐标系的转换关系.利用此关系可以计算出工作机器人的绝对坐标,从而完成工作机器人自定位.

图5 空间点在双目摄像机中成像示意图

Fig.5 Schematic imaging of space point in binocular camera

2.3 运动目标定位

目前,视频运动目标定位方法主要有基于区域生长法、水平垂直投影法以及基于模式分类法[10].基于投影定位方法思路简单,易于实现,精确度高,本文采用基于投影的运动目标定位方法.将运动目标的像素值设为255,其余所有点的像素值设为0,通过对含有运动目标的二值图像进行逐行以及逐列扫描,可以得到运动前景对应的像素点在水平方向以及垂直方向的具体分布情况及坐标值.

通过逐行扫描可以得到运动目标对应像素的最小行号rmin和最大行号rmax,同理通过逐列扫描可以得到运动目标对应像素的最小列号cmin和最大行号cmax,由此可以得到矩形框的两个对角点(cmin,rmin)和(cmax,rmax),矩形的中心点坐标为

xmid=cmin+(cmax-cmin)/2

(3)

ymid=rmin+(rmax-rmin)/2

(4)

式中:xmid为中心坐标的横坐标值;ymid为中心坐标的纵坐标值.

将双目摄像机拍摄到的左右两幅图像中的运动目标检测出来,并用矩形框标记,得出运动目标的中心点坐标,将其作为一对匹配点,利用双目立体视觉视差公式即可求出运动目标在摄像机坐标系下的三维坐标.由于已经通过工作机器人自定位得到摄像机坐标系与世界坐标系之间转换关系,因此,可以计算出运动目标在环境坐标系下的绝对坐标,由此完成运动目标定位过程.

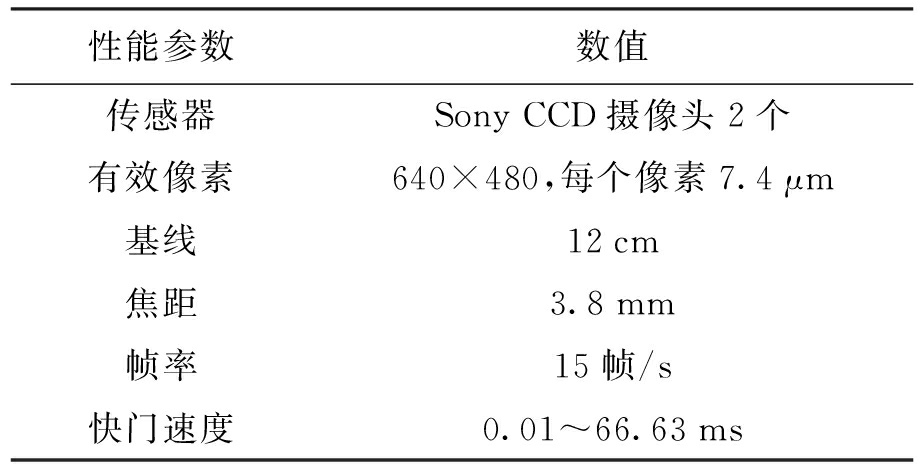

本文使用的机器人是由北京博创兴盛技术有限公司开发的自主移动机器人旅行家Ⅱ号,该机器人为两轮差动式控制,在机器人本体上安装了由加拿大Point Grey Research公司生产的Bumblebee2双目摄像机,摄像机固定在机器人顶部,以期获得较好的图像采集角度.旅行家Ⅱ号机器人本体如图6所示,Bumblebee2摄像机的性能参数如表1所示.

图6 旅行家Ⅱ号机器人

Fig.6 Voyager Ⅱ robot

表1 Bumblebee2双目摄像机性能参数

Tab.1 Performance parameters for Bumblebee2 binocular camera

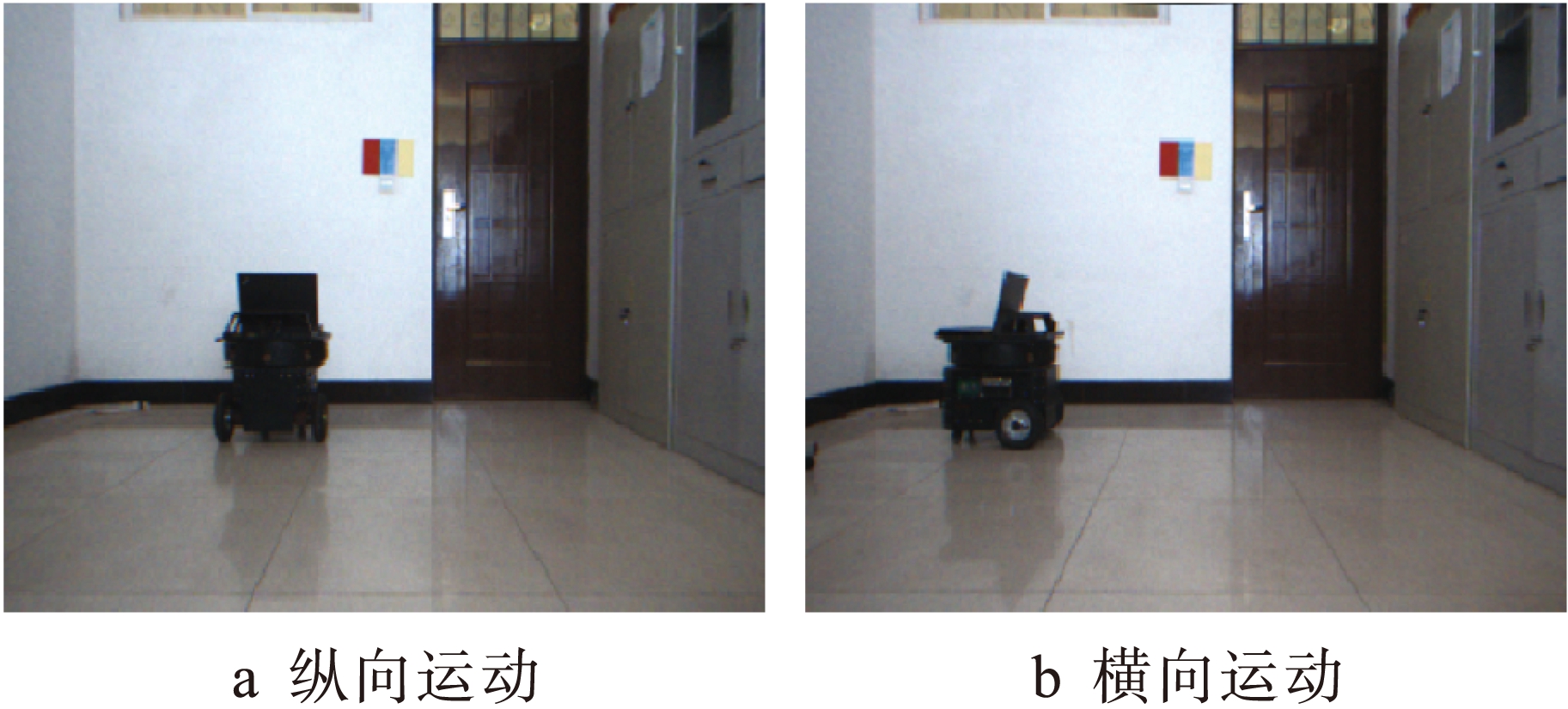

3.1 运动目标检测仿真结果

装有双目摄像机Bumblebee2的移动机器人为工作机器人,实验环境中将另一台移动机器人作为运动目标.运动目标在实验环境中分别作纵向运动与横向运动,运动速度为0.1 m/s,如图7所示.墙上贴有由红、蓝、黄三种颜色构成的人工路标,双目摄像机对工作机器人所处环境每1 s采集一帧图像,共采集15帧.

图7 实验环境

Fig.7 Experimental environment

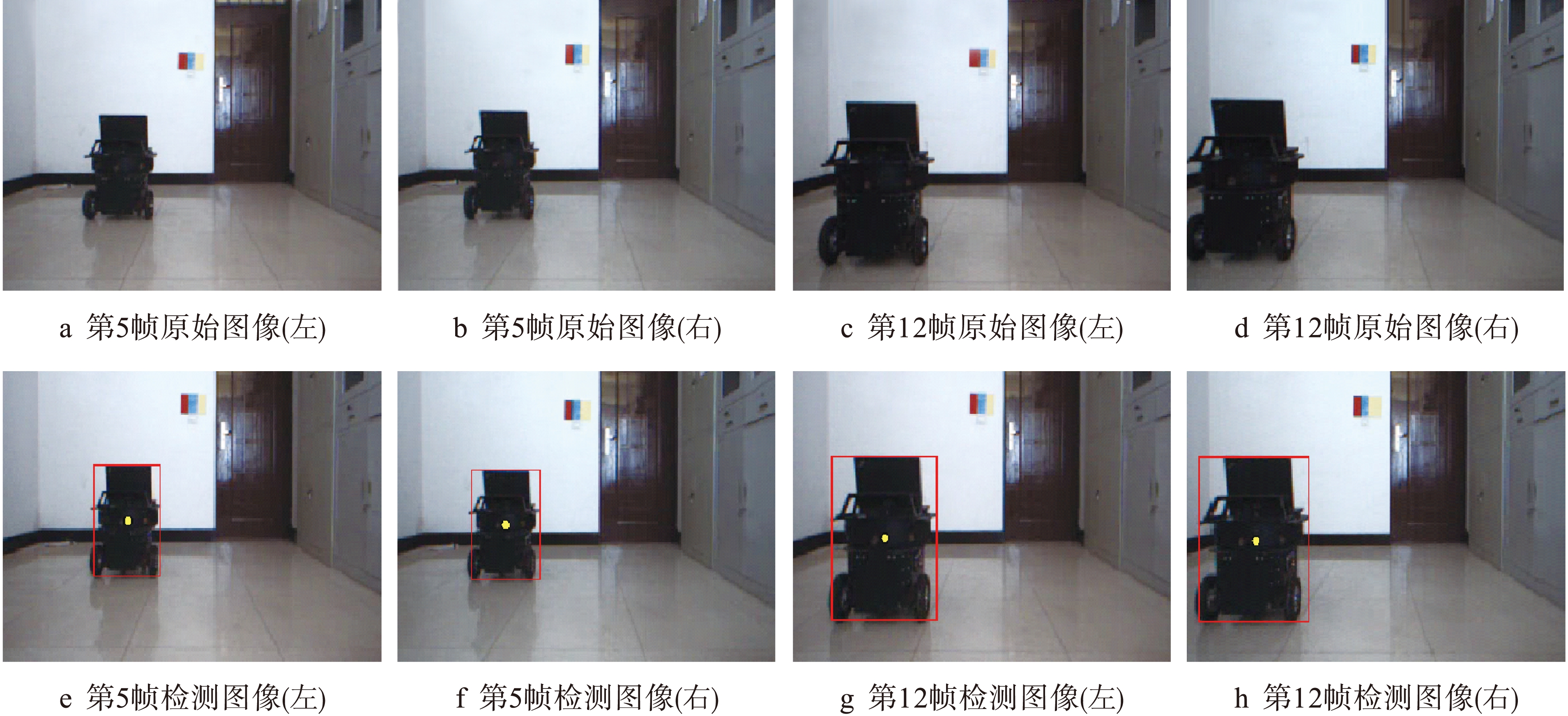

图8为检测运动目标纵向运动示意图,图8a~d分别为双目摄像机采集到的原始视频第5帧和第12帧左右两幅图像;图8e~h为利用帧间差分法对运动目标进行检测并用矩形框进行标记的结果示意图.

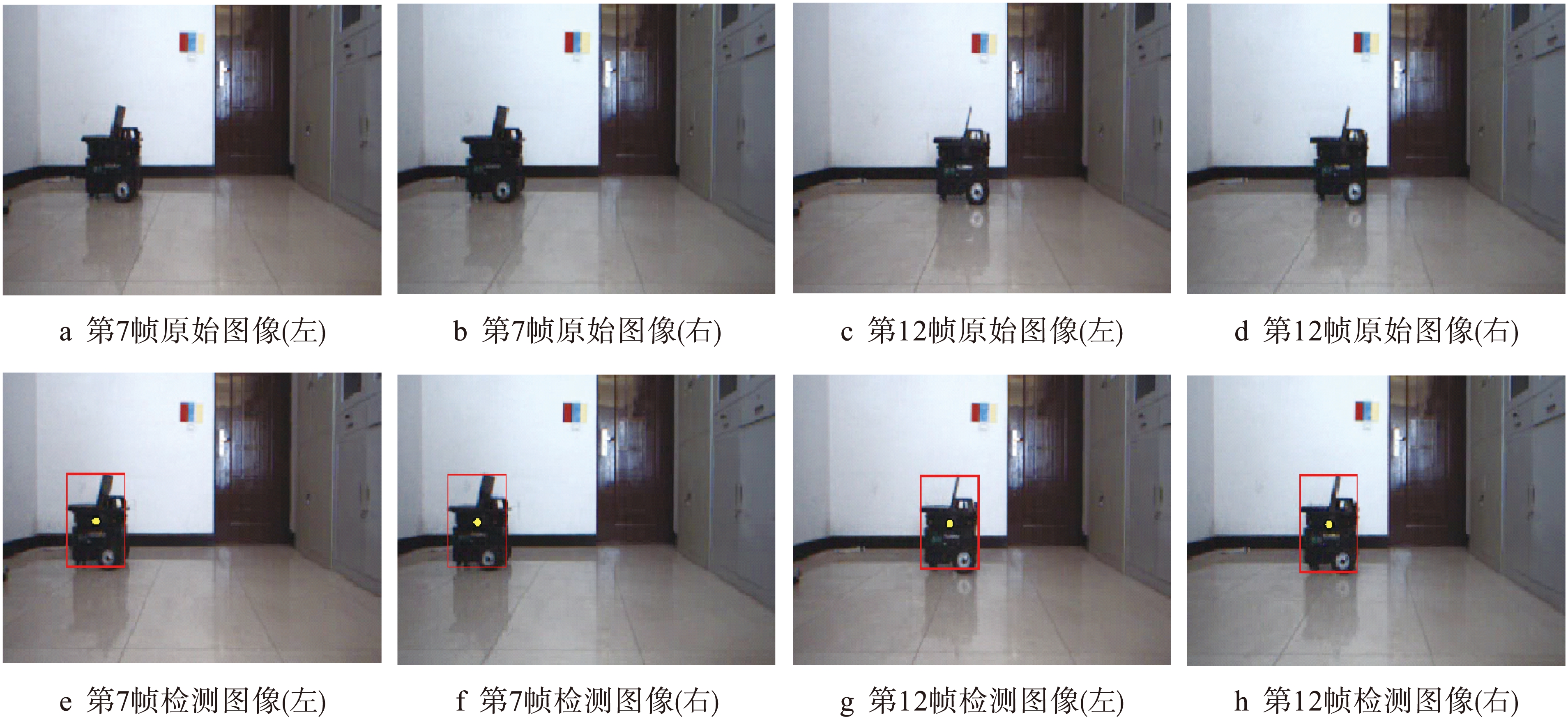

图9为检测运动目标水平运动示意图,图9a~d分别为双目摄像机采集到的原始视频第7帧和第12帧左右两幅图像;图9e~h分别为利用帧间差分法对运动目标进行检测并用矩形框进行标记的结果示意图.

3.2 传统移动机器人自定位

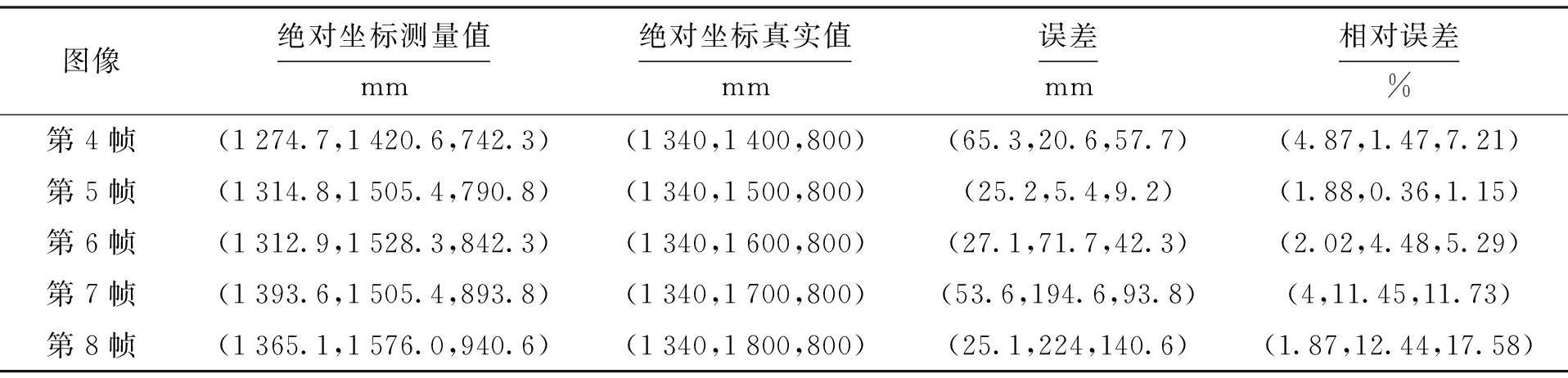

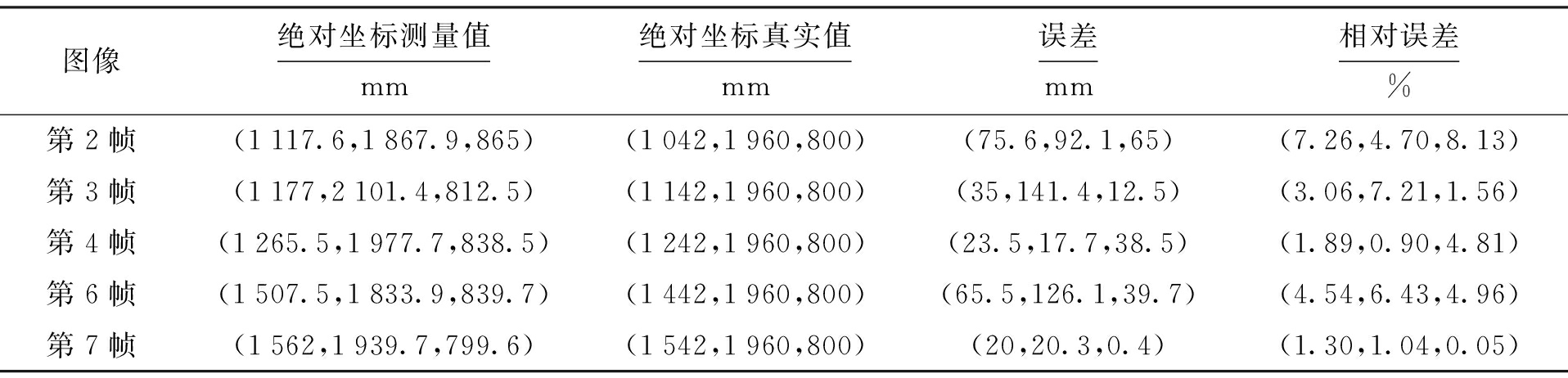

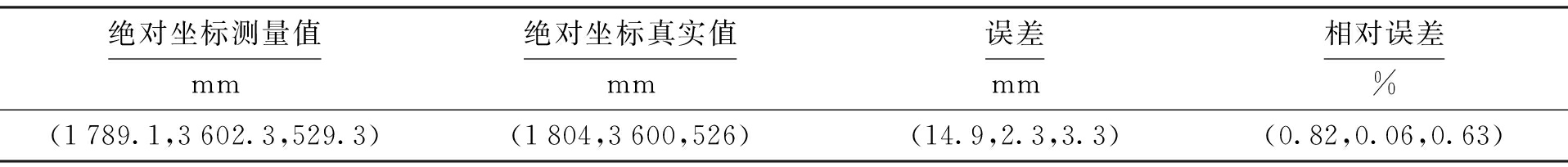

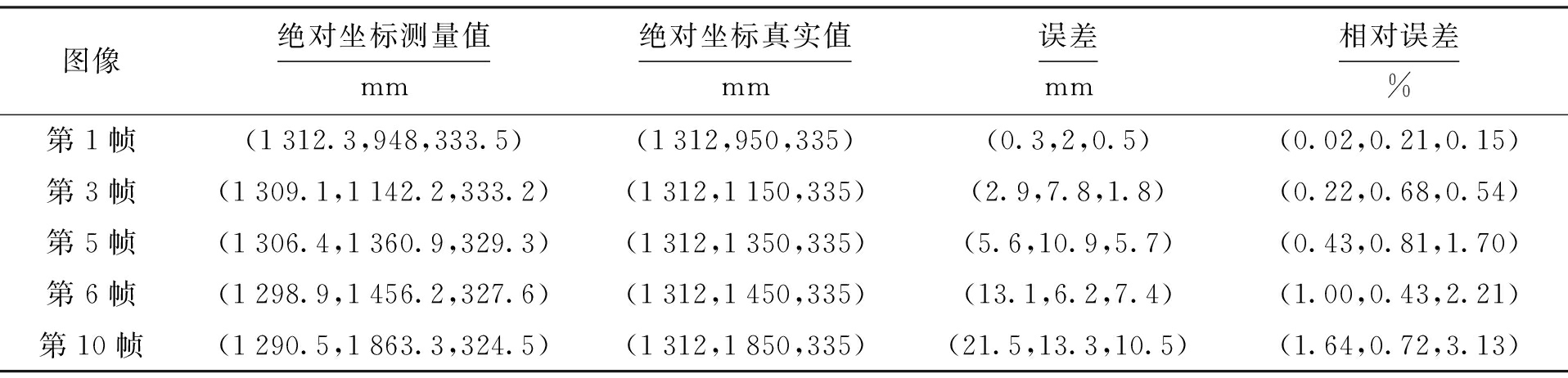

传统移动机器人纵向与水平运动自定位数据如表2和表3所示.

3.3 工作机器人帮助运动目标定位

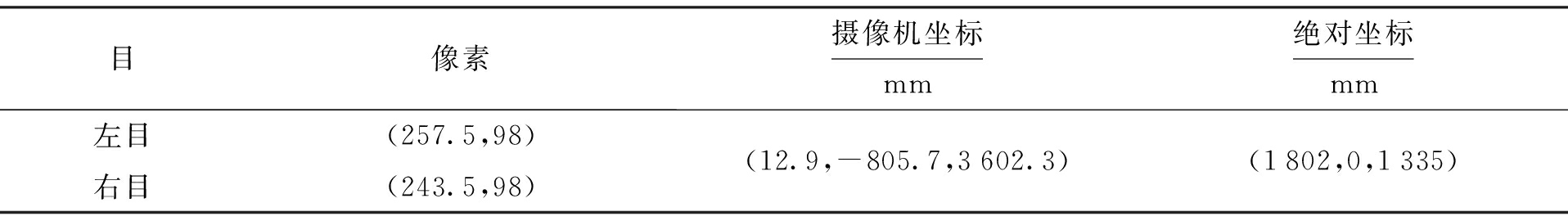

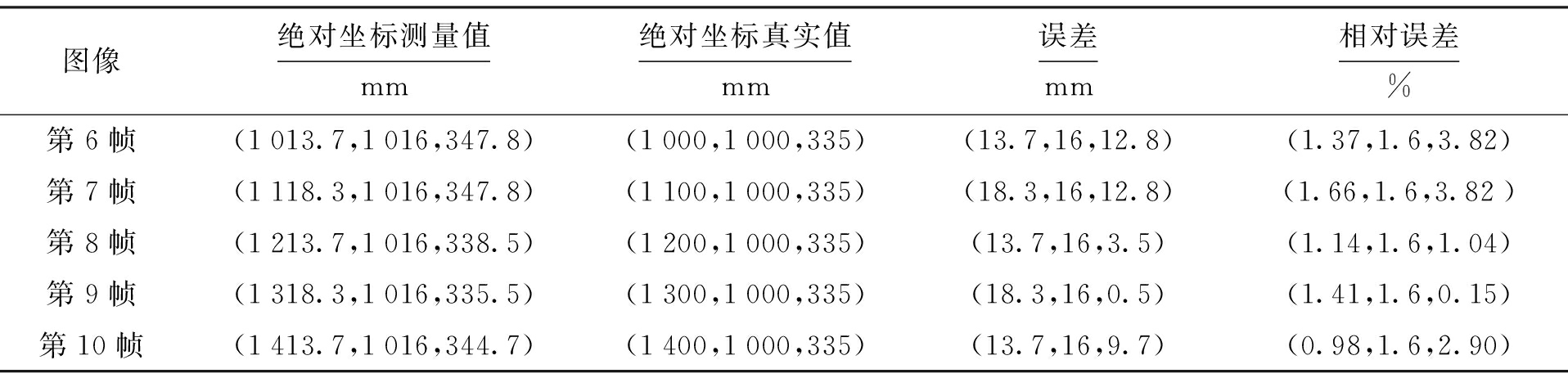

人工路标检测结果数据显示如表4所示,工作机器人自定位数据如表5所示,运动目标纵向运动定位数据如表6所示,运动目标水平运动定位数据如表7所示.

图8 检测运动目标纵向运动示意图

Fig.8 Schematic detection for longitudinal motion of moving object

图9 检测运动目标水平运动示意图

Fig.9 Schematic detection for horizontal motion of moving object

表2 传统方式纵向运动自定位数据

Tab.2 Self-positioning data for longitudinal motion with traditional method

通过与传统机器人自定位数据的对比可以看出,利用工作机器人代替移动机器人进行定位的精度要高于移动机器人自定位的精度.只有极少部分数据显示移动机器人的定位误差更小,但大多数的情形下,采用工作机器人自定位再对运动目标进行检测与定位的方法精度更高.虽然本文所述方法算法较多,但算法比较简单,实时性好,充分满足要求.

表3 传统方式水平运动自定位数据

Tab.3 Self-positioning data for horizontal motion with traditional method

表4 人工路标检测结果

Tab.4 Detection results of artificial landmark

表5 工作机器人自定位数据

Tab.5 Self-positioning data of work robot

表6 运动目标纵向运动定位数据

Tab.6 Longitudinal motion positioning data of moving object

表7 运动目标水平运动定位数据

Tab.7 Horizontal motion positioning data of moving object

本文提出的运动目标检测与定位的思路是首先利用定位机器人自定位,再对运动目标定位.实验结果表明,工作机器人自定位相对误差不足1%,运动目标纵向运动与水平运动定位的相对误差在多数情况下低于工作机器人自定位的误差,且算法的实时性较好,具有现实的研究意义.

参考文献(References):

[1]吴若鸿.基于特征匹配的双目立体视觉技术研究 [D].武汉:武汉科技大学,2010.

(WU Ruo-hong.Research on binocular stereo vision technology based on feature matching [D].Wuhan:Wuhan University of Science and Technology,2010.)

[2]杜宇.三维重建中双目立体视觉关键技术的研究 [D].哈尔滨:哈尔滨理工大学,2014.

(DU Yu.Research on key technology of binocular stereo vision in three-dimensional reconstruction [D].Harbin:Harbin University of Science and Technology,2014.)

[3]余俊.基于双目视觉的机器人目标检测与控制研究 [D].北京:北京交通大学,2011.

(YU Jun.Research on target detection and robot control based on binocular vision [D].Beijing:Beijing Jiaotong University,2011.)

[4]张本法,孟祥萍,岳华.移动机器人定位方法概述 [J].山东工业技术,2014(22):250.

(ZHANG Ben-fa,MENG Xiang-ping,YUE Hua.Outline of mobile robot localization methods [J].Shandong Industrial Technology,2014(22):250.)

[5]黄雁华,武文远,龚艳春,等.量化颜色直方图的改进与应用 [J].光电技术应用,2011,26(4):76-80.

(HUANG Yan-hua,WU Wen-yuan,GONG Yan-chun,et al.Improvement and application of color histogrm [J].Electro-optic Technology Application,2011,26(4):76-80.)

[6]郭英华.基于HSV色彩空间的图像分割 [J].黑龙江冶金,2011,31(2):35-37.

(GUO Ying-hua.Image segmentation based on HSV color space [J].Heilongjiang Metallurgy,2011,31(2):35-37.)

[7]陈向东,李平.基于色彩特征的CAMSHIFT视频图像汽车流量监测 [J].沈阳工业大学学报,2015,37(2):183-188.

(CHEN Xiang-dong,LI Ping.Vehicle flow detection with CAMSHIFT video images based on color feature [J].Journal of Shenyang University of Technology,2015,37(2):183-188.)

[8]张晓慧.视频监控运动目标检测算法的研究与实现 [D].西安:西安电子科技大学,2012.

(ZHANG Xiao-hui.Research and implementation on moving object detection algorithm in video surveill ance [D].Xi’an:Xidian University,2012.)

[9]靳盼盼.双目立体视觉测距技术研究 [D].西安:长安大学,2014.

(JIN Pan-pan.Study on the technology of binocular stereo vision measurement [D].Xi’an:Chang’an University,2014.)

[10]张君昌,李明,谷卫东.融合减法聚类与C-均值聚类的目标定位方法 [J].计算机仿真,2012,29(7):269-273.

(ZHANG Jun-chang,LI Min,GU Wei-dong.Joint subtractive clustering and C-means clustering object Location algorithm [J].Computer Simulation,2012,29(7):269-273.)

(责任编辑:景 勇 英文审校:尹淑英)

CUI Bao-xia, LUAN Ting-ting, ZHANG Chi, DUAN Yong

(School of Information Science and Engineering, Shenyang University of Technology, Shenyang 110870, China)

Abstract:In order to solve the problem that the self-positioning precision of mobile robot is low, a method, where the self-positioning of stationary work robot is firstly performed and then the moving object is detected and positioned, was proposed. Based on the HSV model colour feathers, the work robot divided the artificial landmark and performed the self-positioning. In addition, the differential operation for two adjacent frames in the collected video image sequence was performed with frame differential method, and the moving object was extracted. The absolute coordinates of moving object were calculated with binocular stereo vision parallax principle, which could help the moving object to complete the positioning. The results show that the positioning accuracy of the proposed method is higher than that of traditional mobile robot, and the algorithm shows good real-time performance and has the practical significance.

Key words:binocular vision; mobile robot; frame differential method; moving object; artificial landmark; HSV model; threshold segmentation; positioning

收稿日期:2015-08-27.

基金项目:国家自然科学基金资助项目(60695054); 辽宁省高等学校优秀科技人才支持计划(LR2015045).

作者简介:崔宝侠(1962-),女,辽宁沈阳人,教授,博士,主要从事过程控制、管理信息系统及决策支持系统等方面的研究.

doi:10.7688/j.issn.1000-1646.2016.04.11

中图分类号:TP 391.4

文献标志码:A

文章编号:1000-1646(2016)04-0421-07

*本文已于2015-12-07 16∶18在中国知网优先数字出版. 网络出版地址: http:∥www.cnki.net/kcms/detail/21.1189.T.20151207.1618.024.html