王金茹

(沈阳体育学院 管理与新闻传播学院, 沈阳 110102)

摘 要: 针对传统融合算法处理聚焦区域能力弱、边缘效果差以及目标轮廓提取存在缺陷等问题,提出了基于稀疏分解和背景差分融合的方法.稀疏分解经过鲁棒主成分分析方式提取多聚焦图像轮廓,从而为源图像的准确分离奠定基础;背景差分融合依照源图像与增强图像的差异图提取轮廓信息以准确定位聚焦区域,从而防止引入人工干扰.结果表明,与传统方法相比,本文提出的方法在很大程度上提升了融合效果,能够很好地加强其对噪声的鲁棒性,同时表现出很好的视觉效果.

关 键 词: 稀疏分解; 背景差分融合; 鲁棒主成分分析; 图像融合; 多尺度变换; 剪切波变换; 图像处理; 融合算法

随着传感器技术的持续发展,其展示出成像机理多样化、工作波段多元化及功能模块协同化等特征[1].但是单一类型传感器在很大程度上受到成像形式、工作波长区间以及运行环境等条件约束[2],致使摄取的图像在显示场景对象时存在片面性以及表面化等缺点,进而导致其不能完整、可靠稳健地展现拍摄目标的真实情况[3].多光谱图像光谱分辨率很高,然而其空间分辨率却在很大程度上有所降低,而全色图像空间分辨率相对很高,但其光谱分辨率却在很大程度上有所下降[4].单一传感器在低能见度及高噪声等干扰下,其摄取对象的性能有所减弱,不能完整地展现复杂场景细节[5].针对上述算法存在的不足,本文研究设计了基于稀疏分解和背景差分融合的图像处理方法.

对给定数据集进行排序,并构建矩阵D∈Rm×n,同时假定D能够分解成低秩以及稀疏矩阵A与E的累加.通过鲁棒主成分分析[6](RPCA)可以复原矩阵D的低秩结构A和稀疏分量E,其求解模型为

(1)

式中:λ>0,为缩放因子;![]() 为矩阵的l1范数.

为矩阵的l1范数.

运用增广拉格朗日乘子法以最大程度地提高迭代速率,完成源图像的分解,建立的拉格朗日函数为

L(X,Y,μ)= f(X)+[Y,h(X)]+

(2)

式中:f(X)及h(X)分别为目标函数及约束条件;μ为标量系数;X为观测数据矩阵;Y为数据矩阵的列向量;![]() 为矩阵的Frobenius范数.

为矩阵的Frobenius范数.

令![]() 则约束条件为h(A,E)=D-A-E,增广拉格朗日函数为

则约束条件为h(A,E)=D-A-E,增广拉格朗日函数为

(3)

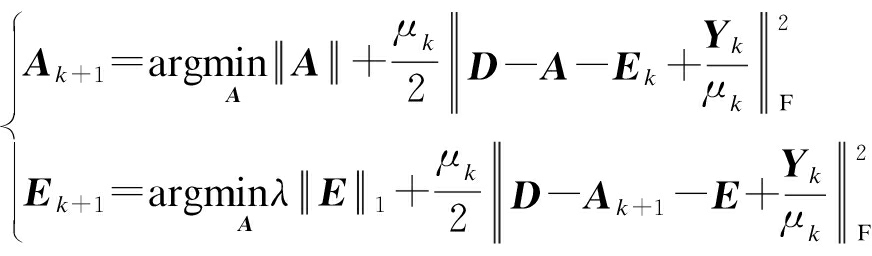

交替更新A及E完成求解,即

(4)

如果Ak+1→A,Ek+1→E,则交替更新完成,然后更新Y及μ,直至符合约束条件,更新表达式为

(5)

式中:ρ为常数系数;k为更新次数.

收敛的必要条件为集合{μk}务必是单调递增序列,同时![]() 其在很大程度上改变了速度,直接判定算法收敛性.

其在很大程度上改变了速度,直接判定算法收敛性.

非精确的增广拉格朗日乘子法运用部分奇异值分解[7],能够表现出更好的收敛速度,与此同时,其在重建精度上也呈现出更好的性能,求解其稀疏部分的目标函数为

(6)

式中:S为稀疏分量;L为拉格朗日函数.目标函数的线性优化求解流程如下:

1) 构建原始的图像矩阵D∈Rm×n,获取Y0,E0,并令k=0,μ0>0,ρ>1,进行初始化.

2) 完成矩阵D奇异值的分解,分解表达式为

(7)

式中:Ji为低秩结构A的第i行向量;ε为最大可容忍误差;U、V为奇异向量;Δτ为变化增量;svd为奇异分解函数.

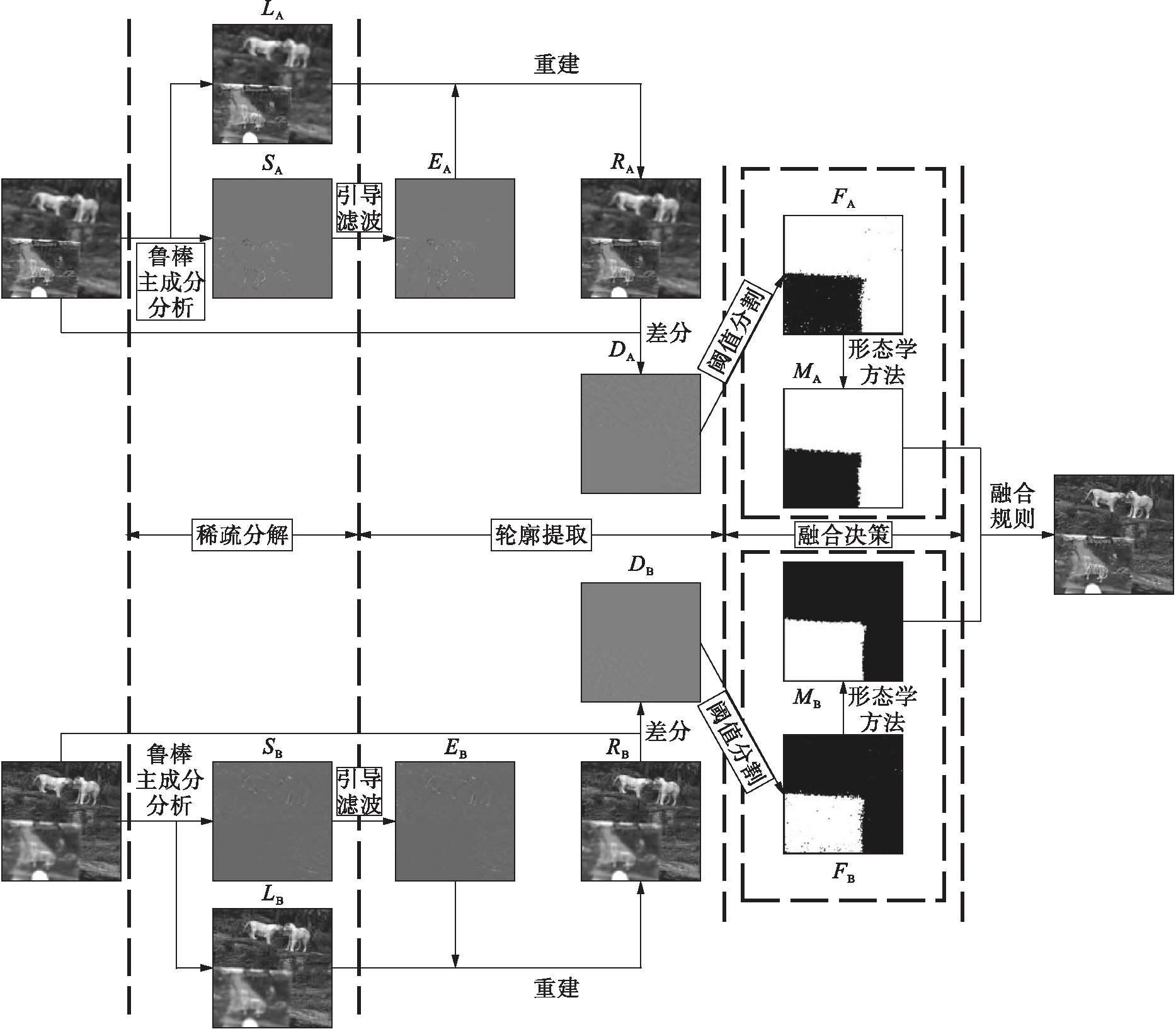

3) 根据U、S、V更新A、E及Y,更新表达式为

(8)

4) 更新参数μk+1=ρμk,k=k+1.

5) 如果算法没有收敛,则就跳转到步骤2);反之则运算结束,输出(A,E,Δτ).

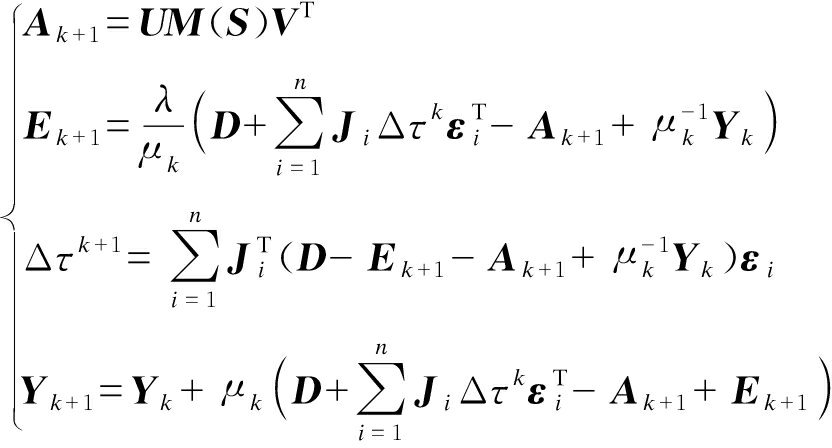

本文设计的背景差分融合流程图如图1所示.

图1中多聚焦图像经过稀疏分解能够获得两幅源图像的低秩以及稀疏分量,分别表示为LA、LB及SA、SB,分量经过引导滤波[8-9]获得加强的稀疏分量EA、EB,RA、RB表示增强图像,增强及源图像经过差分获得图像DA及DB,其空间频率图由FA及FB表示,MA及MB表示融合决策图,整个算法流程如下:

1) 将源图像经过鲁棒性主成分分析,获得低秩及稀疏分量LA、LB以及SA、SB.

2) 运用引导滤波器增强SA、SB中的边缘信息,获得加强的稀疏分量EA、EB,从而能够更好地获得聚焦区域的轮廓信息.

3) 获得增强图像RA及RB,即

(9)

图1 算法流程图

Fig.1 Flow chart of algorithm

4) 经过差分获得能够反映源图像及增强图像的差分图.

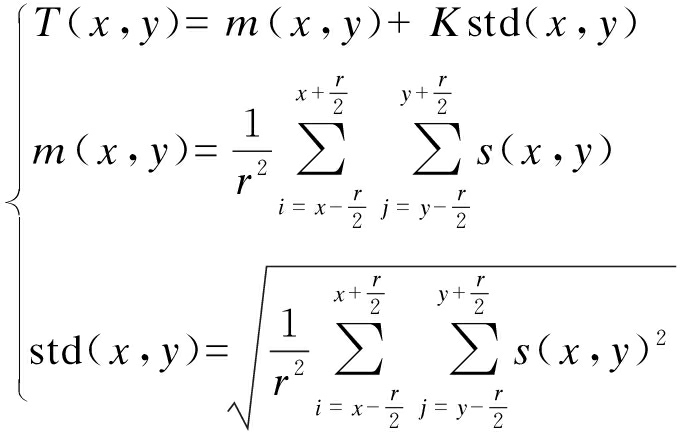

5) 运算空间频率获得FA及FB,然后利用自适应阈值算法获得MA及MB,其中阈值T(x,y)获取表达式为

(10)

式中:r为滑动窗口尺度;s(x,y)为像素(x,y)的灰度值;K为调节常数;m(x,y)及std(x,y)分别为像素均值及标准差.

6) 在聚焦区域检测过程中,中间相关联的某些部分总会出现断续线及毛刺等情况,如果对其处理不妥当将在很大程度上使检测区域粘连或缺失[10-11].为了防止出现这些问题,运用形态学分析中的小尺寸元素对其进行开闭控制,使得聚焦区域边缘过渡更加平滑,从而尽可能地剔除断续线及毛刺.然后再运用形态学方法补充聚焦区域,同时剔除其中的假聚焦区域,从而获得相对比较完善的融合决策图.

7) 构建融合规则及系数,最终获得融合图像.

为了检验稀疏分解和背景差分融合方法的有效性,本文进行了实验分析,实验图像的尺寸为520×520像素,实验图像如图2所示.

使用本文提出的方法与基于非下采样轮廓波变换(NSCT)[12]及离散小波变换(DWT)[13]两种融合方法进行对比分析,设定参数如下:

1) NSCT融合方式.4级分解的每一个方向数目分别是4、8、8及16,金字塔及方向滤波器分别是“9-7”及“7-9”.

图2 实验图像

Fig.2 Experimental image

2) DWT融合方式.设定小波分解层数等于3,分别运用极大值法择取低频融合及高频系数.

3) 稀疏分解和背景差分融合方法形态学分析选择的结构元素为“disk”.

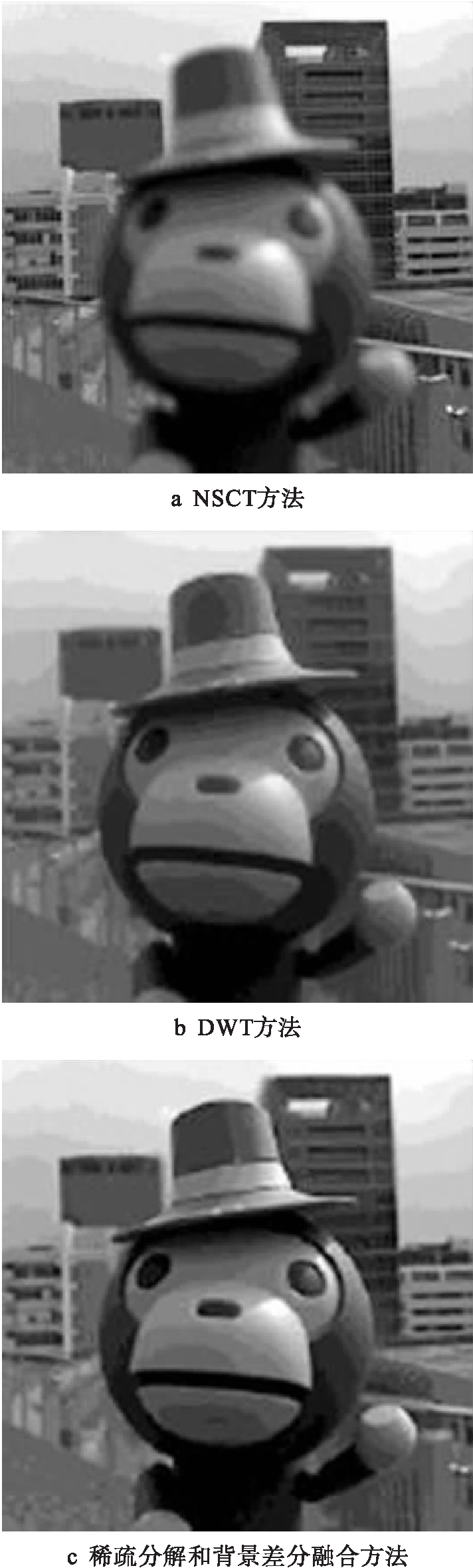

采用3种算法分别对原图进行融合,融合结果如图3所示.根据图3可知:NSCT方式获得的融合图像其某些边缘信息在很大程度上出现缺失,同时其聚焦区域也出现了显著的虚假情况;DWT方式获得的融合图像尽管其拥有多尺度分析的优点,但是因为受到采样操作的影响,致使融合图像在很大程度上出现伪吉布斯情况,进而导致其图像质量大大降低,另外其捕捉方向能力相对来说非常弱,从而致使融合图像内发生人工扭曲迹象;稀疏分解和背景差分融合方法获得的融合图像最大程度地获取了源图像的聚焦区域,从而在很大程度上囊括了相对更加清晰的轮廓及完善的细节,进而使其能够更加准确地提取源图像.与此同时,其融合过程中很大程度上避免了人工干扰引入融合图像.

综上所述,NSCT以及DWT融合方法在很大程度上受到模糊及振铃效应等人工干扰,从而导致其融合质量大大降低.本文提出的稀疏分解和背景差分融合方法表现出更加稳健的效果,其视觉效果在很大程度上得到了提高,明显优于NSCT以及DWT融合方法.

本文运用互信息(MI)[14]、边缘强度(QAB/F)[15]以及交叉熵(QE)[16]三个指标进一步判定融合以及源图像的相关性.边缘强度是边缘点梯度的幅值;交叉熵主要用于度量两个概率分布间的差异性信息;互信息是信息论里一种重要的信息度量,是一个随机变量中包含的关于另一个随机变量的信息,或者说是一个随机变量由于已知另一个随机变量而减少的不确定性.设两个随机变量(x,y)的联合分布为p(x,y),边际分布分别是p(x)、p(y),互信息MI(x,y)是联合分布p(x,y)与边际分布p(x)与p(y)乘积的相对熵,即

图3 融合结果

Fig.3 Fusion results

(11)

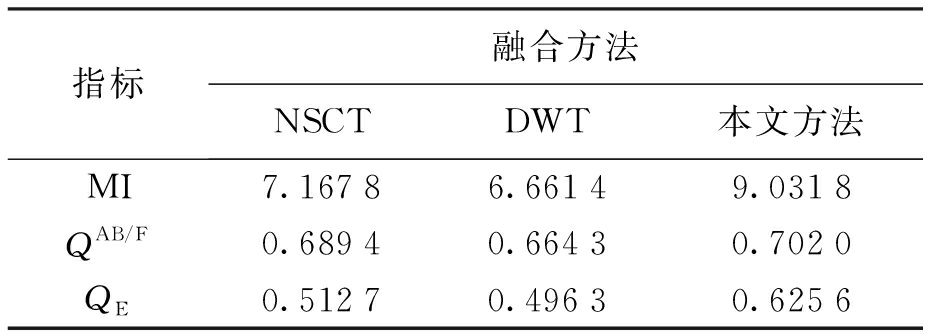

3种方法融合结果指标值对比结果如表1所示.

表1 融合结果指标值

Tab.1 Indexes of fusion results

根据表1可知,本文提出的稀疏分解和背景差分融合方法使3个指标在很大程度上得到了提升.指标数值越大,说明融合图像中涵盖的来自于源图像中的信息也就越多,从而说明稀疏分解和背景差分融合方法在很大程度上提升了聚焦区域的提取精度.

本文提出了基于稀疏分解和背景差分的融合方法,通过鲁棒性主成分分析凸显了稀疏域聚焦区域的轮廓信息,背景差分融合依照源图像及增强图像的差异图提取轮廓信息以准确定位聚焦区域.通过实验与传统方法进行对比,结果表明:

1) 该方法能够相对准确地提取源图像中的聚焦区域,识别不同目标,并且能够自然地从聚焦区域向背景区域过渡;

2) 该方法得到的融合图像相对更广泛地汲取源图像中的信息,在很大程度上防止人工干扰,加强其对噪声的鲁棒性,同时在很大程度上提升了融合图像的视觉效果.

参考文献(References):

[1] 蔡建宏,李跃新.结合背景差分和显著值筛选的运动检测算法 [J].计算机测量与控制,2017,25(6):250-253.

(CAI Jian-hong,LI Yue-xin.A motion detection method combined with background subtraction and salience value filtering [J].Computer Measurement and Control,2017,25(6):250-253.)

[2] 徐川.基于稀疏表示的图像超分辨率重建技术研究 [D].金华:浙江师范大学,2016.

(XU Chuan.Study on image super-resolution reconstruction based on sparse representation [D].Jinhua:Zhejiang Normal University,2016.)

[3] 王庆,张葛祥,荣海娜,等.基于稀疏分解的交通图像压缩 [J].公路交通科技,2010,27(6):112-116.

(WANG Qing,ZHANG Ge-xiang,RONG Hai-na,et al.Traffic image compression based on sparse de-composition [J].Journal of Highway and Transportation Research and Development,2010,27(6):112-116.)

[4] 侯跃恩.基于稀疏表示的视觉目标跟踪算法研究 [D].广州:华南理工大学,2014.

(HOU Yue-en.Based on sparse representation of visual target tracking algorithm [D].Guangzhou:South China University of Technology,2014.)

[5] 李珅.基于稀疏表示的图像去噪和超分辨率重建研究 [D].西安:西安光学精密机械研究所,2014.

(LI Kun.Research on image denoising and super reso-lution reconstruction based on sparse representation [D].Xi’an:Xi’an Institute of Optics and Fine Mechanics,2014.)

[6] 胡建文.基于多尺度滤波和稀疏表示的图像融合方法研究 [D].长沙:湖南大学,2013.

(HU Jian-wen.Study on image fusion method based on multi-scale filtering and sparse representation [D].Changsha:Hunan University,2013.)

[7] 王爱丽,董宝田,王泽胜.融合背景差分的二次重构和内外标记分水岭的行人检测方法 [J].交通运输系统工程与信息,2014,14(4):66-72.

(WANG Ai-li,DONG Bao-tian,WANG Ze-sheng.Construction method of quadratic reconstruction of fusion background difference and inner and outer marker watershed [J].Journal of Transportation Systems Engineering and Information,2014,14(4):66-72.)

[8] 赵蓓蕾,吴亚婷,李强.基于形态学与灰度模态分析的阴影去除方法 [J].兵工自动化,2013,32(12):15-19.

(ZHAO Bei-lei,WU Ya-ting,LI Qiang.Shadow removal method based on morphological gradation modal analysis [J].Industry Automation,2013,32(12):15-19.)

[9] 刘玉淑.基于多尺度变换的图像去噪及融合算法研究 [D].济南:山东大学,2013.

(LIU Yu-shu.Image denoising and fusion algorithm based on multi-scale transform [D].Jinan:Shandong University,2013.)

[10]程发斌,汤宝平,何启源.基于小波多尺度分解的区域图像融合及算法研究 [J].中国机械工程,2006,17(增刊2):353-356.

(CHENG Fa-bin,TANG Bao-ping,HE Qi-yuan.Study area and image fusion algorithm based on wavelet multiscale decomposition [J].China Mechanical Engineering,2006,17(Sup 2):353-356.)

[11]张跃飞.基于稀疏分解的图像压缩 [D].成都:西南交通大学,2006.

(ZHANG Yue-fei.Image compression based on sparse decomposition [D].Chengdu:Southwest Jiaotong University,2006.)

[12]Yang X,Jiao L.Fusion algorithm for remote sensing images based on nonsubsampled contourlet transform [J].Acta Automatica Sinica,2008,34(3):274-281.

[13]Cunha A L,Zhou J P,Do M N.Nonsubsampled contourlet transform:filter design and application in image denoising [C]//International Conference on Image Processing.Miami,USA,2005:469-472.

[14]Qu G,Zhang D,Yan P.Information measure for performance of image fusion [J].Electronics Letters,2002,38(7):313-315.

[15]Xydeas C S,Petrovic V.Objective image fusion performance measure [J].Electronics Letters,2000,36(4):308-309.

[16]Piella G,Heijmans H.A new quality metric for image fusion [C]//International Conference on Image Processing.Colorado,USA,2003:173-176.

WANG Jin-ru

(School of Management and Journalism, Shenyang Sport University, Shenyang 110102, China)

Abstract: Aiming at the problems that in the traditional fusion algorithm, the capacity to deal with the focus area is weak, the edge effect is poor, and the defects exist in the target contour extraction, a method based on the sparse decomposition and background difference fusion was proposed. The contours of multi-focus image were extracted with the sparse decomposition method in the robust principal component analysis mode, which could provide the foundation for the exact separation of source image. According to the difference diagram between both source and enhanced images, the contour information was extracted in the background difference fusion method to accurately locate the focus area, and thus the introduction of manual interference could be prevented. The results show that compared with the traditional method, the proposed method can greatly increase the fusion effect, enhance its robustness to noise, and exhibits good visual effect at the same time.

Key words: sparse decomposition; background differential fusion; robust principal component analysis; image fusion; multi-scale transform; shear wave transform; image processing; fusion algorithm

中图分类号: TM 343

文献标志码:A

文章编号:1000-1646(2018)04-0436-05

收稿日期: 2017-08-28.

基金项目: 辽宁省自然科学基金资助项目(2015020031); 2015年度辽宁省社科联与高校社科联合作课题(lslgslhl-156).

作者简介: 王金茹(1977-),女,辽宁沈阳人,讲师,硕士,主要从事数字图像处理及IP网络通信等方面的研究.

* 本文已于2018-06-26 10∶49在中国知网优先数字出版.

网络出版地址: http:∥kns.cnki.net/kcms/detail/21.1189.T.20180625.1827.004.html

doi:10.7688/j.issn.1000-1646.2018.04.14

(责任编辑:景 勇 英文审校:尹淑英)